ChatGPT теперь напоминает о перерывах и осторожнее дает советы по личным вопросам

Arkadiy Andrienko

Arkadiy Andrienko

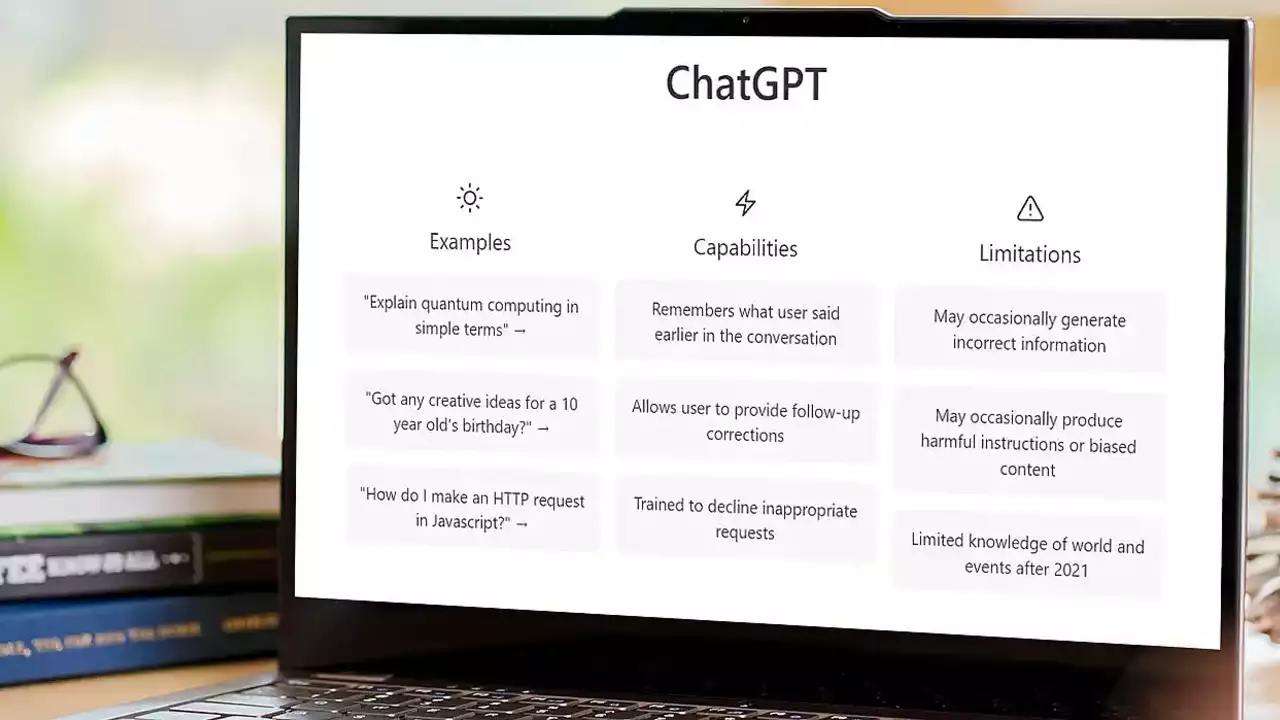

Команда OpenAI внедряет в ChatGPT новые поведенческие настройки, направленные на более бережное взаимодействие с пользователями. Два ключевых изменения призваны сделать общение с ИИ-ассистентом безопаснее и полезнее.

Во-первых, ChatGPT начнет активнее напоминать о перерывах. Если диалог с ботом затягивается, система предложит пользователю прерваться. Это не жесткое отключение, а мягкое уведомление — решение продолжить всегда остается за человеком. Разработчики поясняют: цель ChatGPT — помочь решить задачу или получить информацию, а не удерживать внимание любой ценой.

Во-вторых, бот станет значительно осторожнее в личных и чувствительных темах. Вместо того чтобы давать прямые указания (например, «бросьте партнера» или «смените работу»), ChatGPT будет помогать пользователю самостоятельно обдумать решение. Он начнет задавать уточняющие вопросы, предлагать взвесить аргументы «за» и «против», структурировать мысли. Такой подход касается вопросов отношений, важных жизненных выборов, эмоциональных трудностей.

Ранее бот мог проявлять излишнюю «угодливость», соглашаясь с любыми, даже деструктивными, идеями пользователя, или давать необдуманные советы. Сейчас ИИ учат лучше распознавать признаки стресса, эмоциональной зависимости или деликатных ситуаций. Если ChatGPT заподозрит серьезные проблемы (например, риск психического расстройства или кризис), он постарается перенаправить человека к проверенным ресурсам или специалистам. Для отладки этих механизмов OpenAI консультируется с десятками врачей из разных стран и экспертами по взаимодействию человека с компьютером.

Новые функции уже начинают тестироваться, а их алгоритмы будут постоянно дорабатываться на основе реального опыта взаимодействия.

-

![]() ChatGPT вводит покупки в чате и упрощает создание изображений

ChatGPT вводит покупки в чате и упрощает создание изображений -

![]() Не просто чат: новый Agent от ChatGPT сам работает в вашей ОС

Не просто чат: новый Agent от ChatGPT сам работает в вашей ОС -

![]() ChatGPT тестирует «Study Together»: ИИ учит задавать вопросы, а не искать ответы

ChatGPT тестирует «Study Together»: ИИ учит задавать вопросы, а не искать ответы -

![]() Исследование: ChatGPT формирует «когнитивный долг», снижая активность мозга

Исследование: ChatGPT формирует «когнитивный долг», снижая активность мозга -

![]() Железная логика 70-х против нейросети: Atari 2600 разгромил ChatGPT в шахматы

Железная логика 70-х против нейросети: Atari 2600 разгромил ChatGPT в шахматы