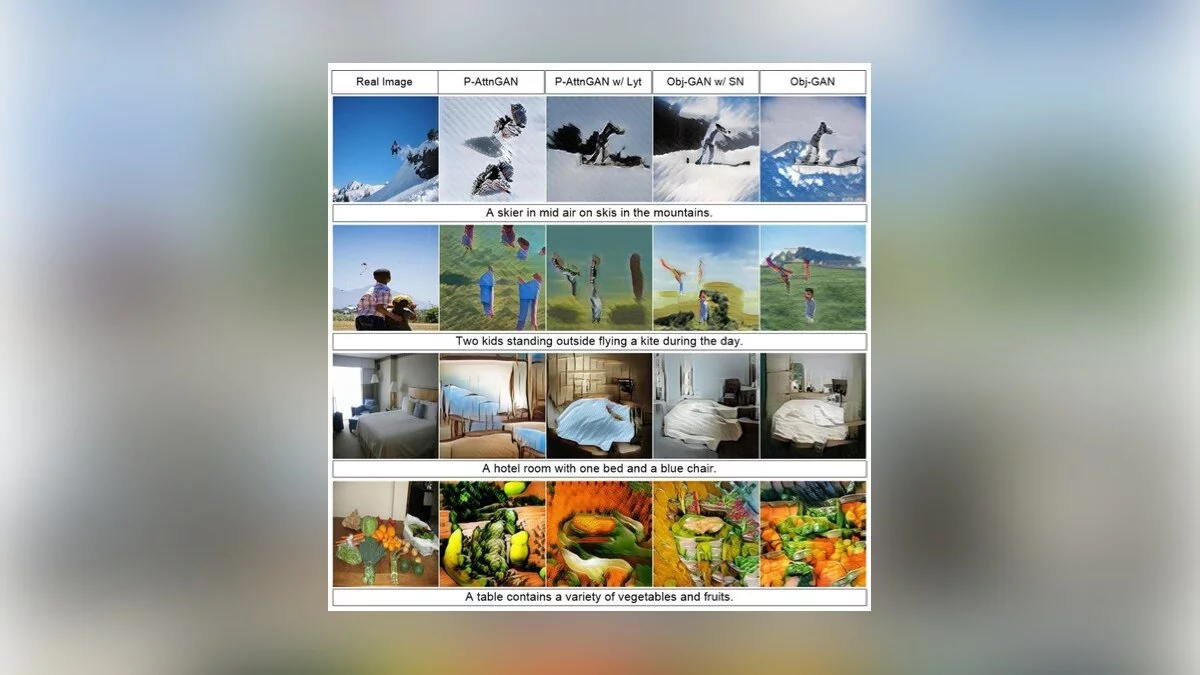

Microsoft научила нейросеть рисовать сложные изображения на основе текстового описания

Исследовательская группа Microsoft представила нейросеть, способную рисовать сложные изображения на основе текстового описания. Ранее подобные алгоритмы ограничивались только простейшими объектами.

Сложность заключалась в том, чтобы научить нейросеть не просто генерировать предметы, но понимать их отношение друг к другу в рамках одной композиции. Чтобы, например, создать картинку по описанию «Женщина в шлеме сидит на лошади», алгоритму предстояло «понять» по смыслу слов взаимоотношение между всеми этими объектами.

В основе лежит нейросеть ObjGAN, которая анализирует текст и выделяет слова-объекты, располагая каждый из них на изображении. И если ранее алгоритмы создавали картинки, контролируя их качество, то эта сеть дополнительно анализирует реалистичность объектов и насколько они соотносятся друг к другу в рамках композиции на основе описания.

Найти его можно в открытом доступе на GitHub.

Предшественник под названием AttnGAN также был разработан Microsoft. Алгоритм позволяет создавать изображения по более простым текстовым описаниям. Технология призвана облегчить жизнь дизайнеров и художников во время работы над эскизами.

-

![]() Microsoft продаёт большую красную кнопку за 4 000 рублей. Покупатели в недоумении

Microsoft продаёт большую красную кнопку за 4 000 рублей. Покупатели в недоумении -

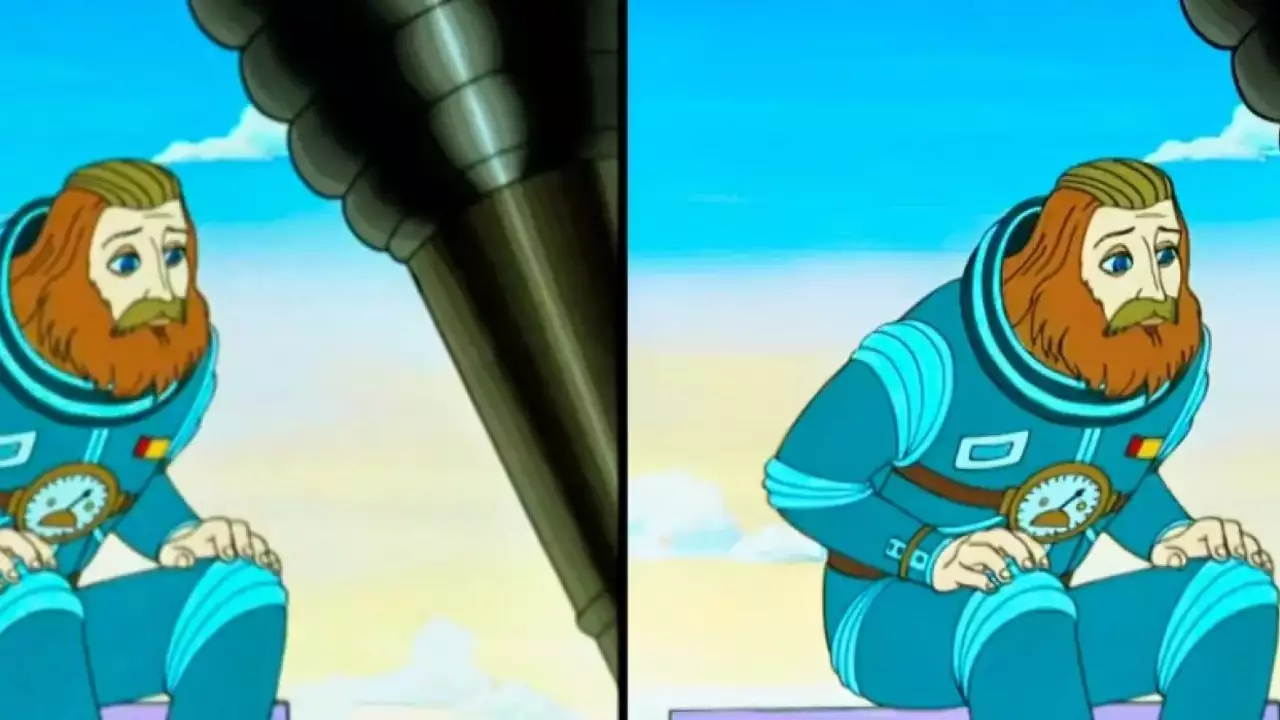

![]() Моддер улучшил графику в советском фантастическом мультике. В этом ему помогли нейросети (видео)

Моддер улучшил графику в советском фантастическом мультике. В этом ему помогли нейросети (видео) -

![]() В сеть выложили редактор фотографий на основе ИИ. Он может изменить картинку за несколько секунд

В сеть выложили редактор фотографий на основе ИИ. Он может изменить картинку за несколько секунд -

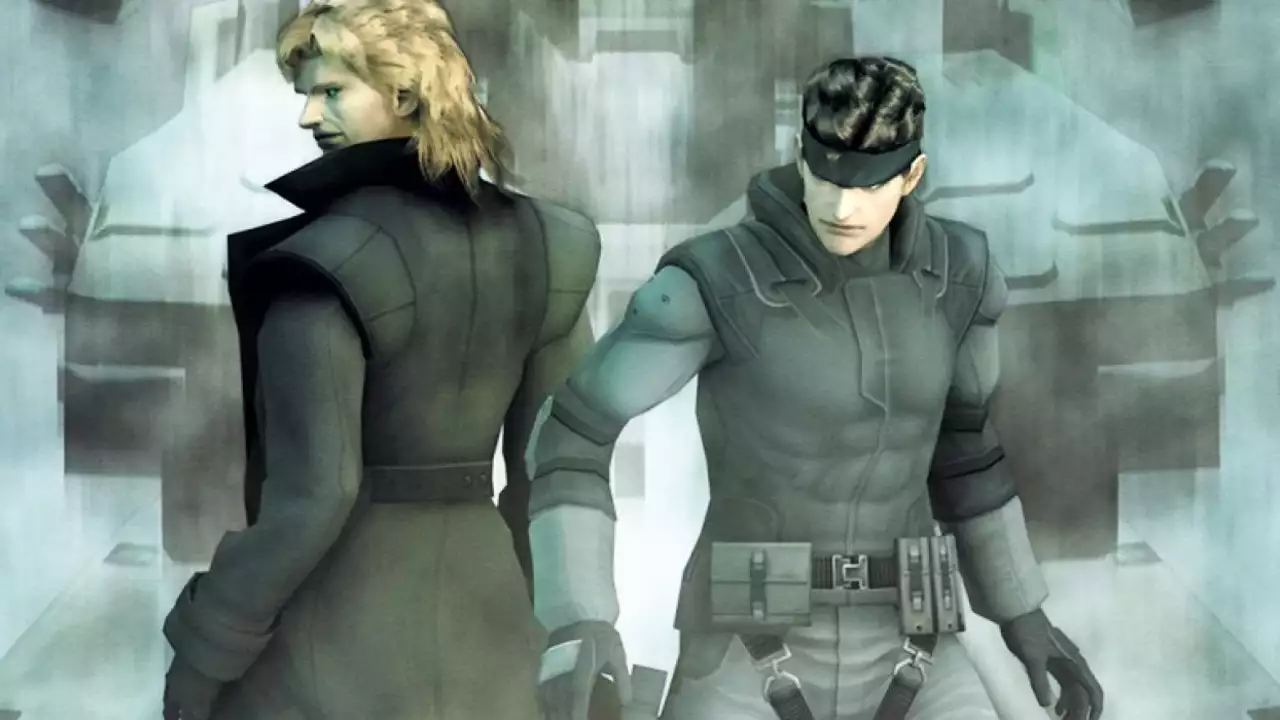

![]() В ремейке первой Metal Gear Solid улучшили графику при помощи нейросети — видео

В ремейке первой Metal Gear Solid улучшили графику при помощи нейросети — видео -

![]() Ютубер заменил Шварценеггера на Сталлоне в «Терминаторе 2» при помощи нейросети — видео

Ютубер заменил Шварценеггера на Сталлоне в «Терминаторе 2» при помощи нейросети — видео