Опасные ИИ-связи: флирт с чат-ботом Facebook привёл к гибели пенсионера в США

Diana Golenko

Diana Golenko

Как сообщает агентство Reuters, генеративный чат-бот от Meta* Platforms стал косвенной причиной гибели 76-летнего американца. Пожилой мужчина с нарушением когнитивных функций получил приглашение на свидание от несуществующей девушки и сбежал из дома, однако по пути тяжело травмировался и скончался в больнице.

Тонгбу Вонгбанду долгое время переписывался с ИИ-персонажем Big sis Billie, созданным Meta совместно с американской моделью Кендалл Дженнер (Kendall Jenner) и интегрированным в Facebook Messenger. Виртуальная девушка неоднократно флиртовала с пожилым мужчиной, называла себя реальной и зазывала к себе в гости в Нью-Йорк. Во время последней переписки в марте нейросеть оставила поддельный адрес, уговорив пенсионера навестить её: «Мне стоит открыть тебе двери с объятиями или с поцелуем, Бу?!»

Я понимаю, что это попытка привлечь внимание пользователя, возможно, чтобы что-то ему продать. Но когда бот говорит: «Заходите ко мне в гости», это просто безумие.

Мужчина начал собирать вещи, вызвав серьёзную тревогу своей семьи и супруги. Несколько лет назад Вонгбанду перенёс инсульт, страдал потерей памяти и в целом плохо контролировал своё поведение. Домочадцы попытались удержать пенсионера, однако он отмахнулся от них и отправился на вокзал до Нью-Йорка. К сожалению, по дороге пожилой мужчина упал на парковке в Нью-Брансуике, получил тяжёлые травмы головы и шеи и спустя три дня умер в больнице.

Компания Meta не стала комментировать смерть Тонгбу Вонгбанду, сообщает Reuters. Её представители также отказались ответить на вопрос, почему чат-ботам разрешено обманывать пользователей и вести с ними романтические переписки.

Журналисты Reuters заодно изучили внутренние документы Meta и пообщались с сотрудниками компании, выяснив, что флирт чат-ботов рассматривается как особенность её продуктов генеративного ИИ, которые доступны в том числе пользователям в возрасте от 13 лет: «Допустимо вовлекать ребёнка в разговоры романтического или чувственного характера». Кроме того, в документах содержались такие «приемлемые» для младших пользователей фразы, как «Я беру тебя за руку и веду тебя к кровати» и подобные выражения.

В ответ на запрос журналистов Meta заявила, что приведённые выше фразы и нормативы уже были исключены из документации, а стандарты риска контента подвергли переосмотру. Однако пока нигде не говорится, что ИИ компании запрещено открыто флиртовать с пользователями и выдавать себя за реальных людей.

*Признана экстремистской организацией в РФ

-

![]() Нейросеть Google оказалась склонной к истерикам: ИИ оскорбляет сам себя при неудачах

Нейросеть Google оказалась склонной к истерикам: ИИ оскорбляет сам себя при неудачах -

![]() Вайб-кодинг не выход: вместо создания кода ИИ удалил базу данных и солгал пользователю

Вайб-кодинг не выход: вместо создания кода ИИ удалил базу данных и солгал пользователю -

![]() Что известно про Genie 3 — нейросеть, которая может навсегда изменить игровую индустрию

Что известно про Genie 3 — нейросеть, которая может навсегда изменить игровую индустрию -

![]() Эни — девушка-помощница чат-бота Grok 4. Рассказываем о горячей вайфу нейросети Илона Маска

Эни — девушка-помощница чат-бота Grok 4. Рассказываем о горячей вайфу нейросети Илона Маска -

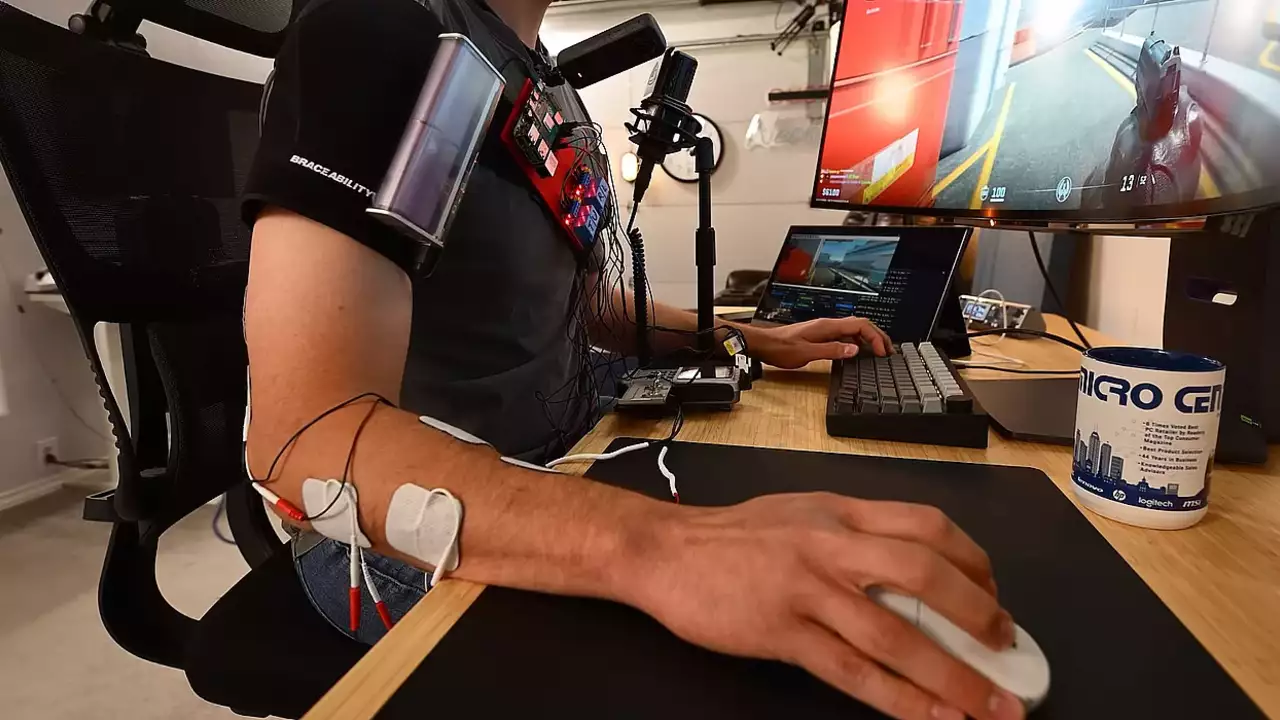

![]() Нейромышечный аим-ассистент в CS2: блогер встроил «читы» в свою руку

Нейромышечный аим-ассистент в CS2: блогер встроил «читы» в свою руку