ИИ забанил 20 тысяч токсичных игроков в CS:GO за полтора месяца

Eduard Zamikhovsky

Eduard Zamikhovsky

Как и во всех соревновательных играх, в CS:GO остро стоит проблема токсичности. Решение нашла компания FACEIT: в августе она подключила к игре искусственный интеллект под названием Minerva, который мониторит чат на наличие оскорбительного контента и наказывает токсичных геймеров. Сегодня компания поделилалсь результатами за первые полтора месяца работы.

Всего за 90 дней ИИ проанализировал свыше 200 миллионов сообщений в чате — из них 7 миллионов система сочла токсичными. Также сообщается, что с помощью Minerva было выдано 90 тысяч предупреждений и забанено 20 тысяч игроков.

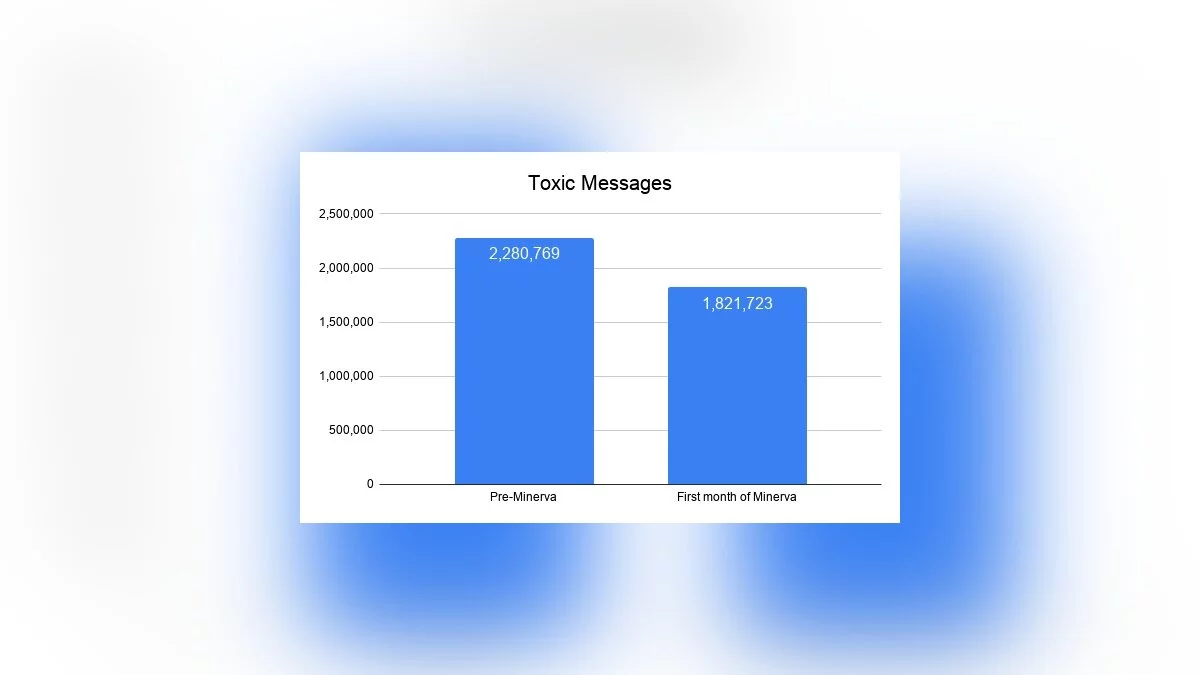

Такой подход оказался весьма результативным: в период с августа по сентябрь количество токсичных сообщений сократилось с 20%, а вредных игроков стало на 8% меньше.

FACEIT планирует и дальше развивать эту технологию. В ближайшие недели компания обещает рассказать о новых системах, которые помогут Minerva в ее обучении.

-

![]() В CS:GO нашли пасхалку, связанную с «Мистером Роботом»

В CS:GO нашли пасхалку, связанную с «Мистером Роботом» -

![]() Valve изменила механику лутбоксов в CS:GO, но игроки не заметили разницы

Valve изменила механику лутбоксов в CS:GO, но игроки не заметили разницы -

![]() Steam атаковали боты, которые рекламируют бесплатные скины для CS:GO и ставят оценки играм

Steam атаковали боты, которые рекламируют бесплатные скины для CS:GO и ставят оценки играм -

![]() Для CS:GO вышло крупное обновление — персонажи, новые карты и операция

Для CS:GO вышло крупное обновление — персонажи, новые карты и операция -

![]() Valve показала нож из CS 1.6 в CS:GO и взбудоражила тем самым фанатов игры

Valve показала нож из CS 1.6 в CS:GO и взбудоражила тем самым фанатов игры